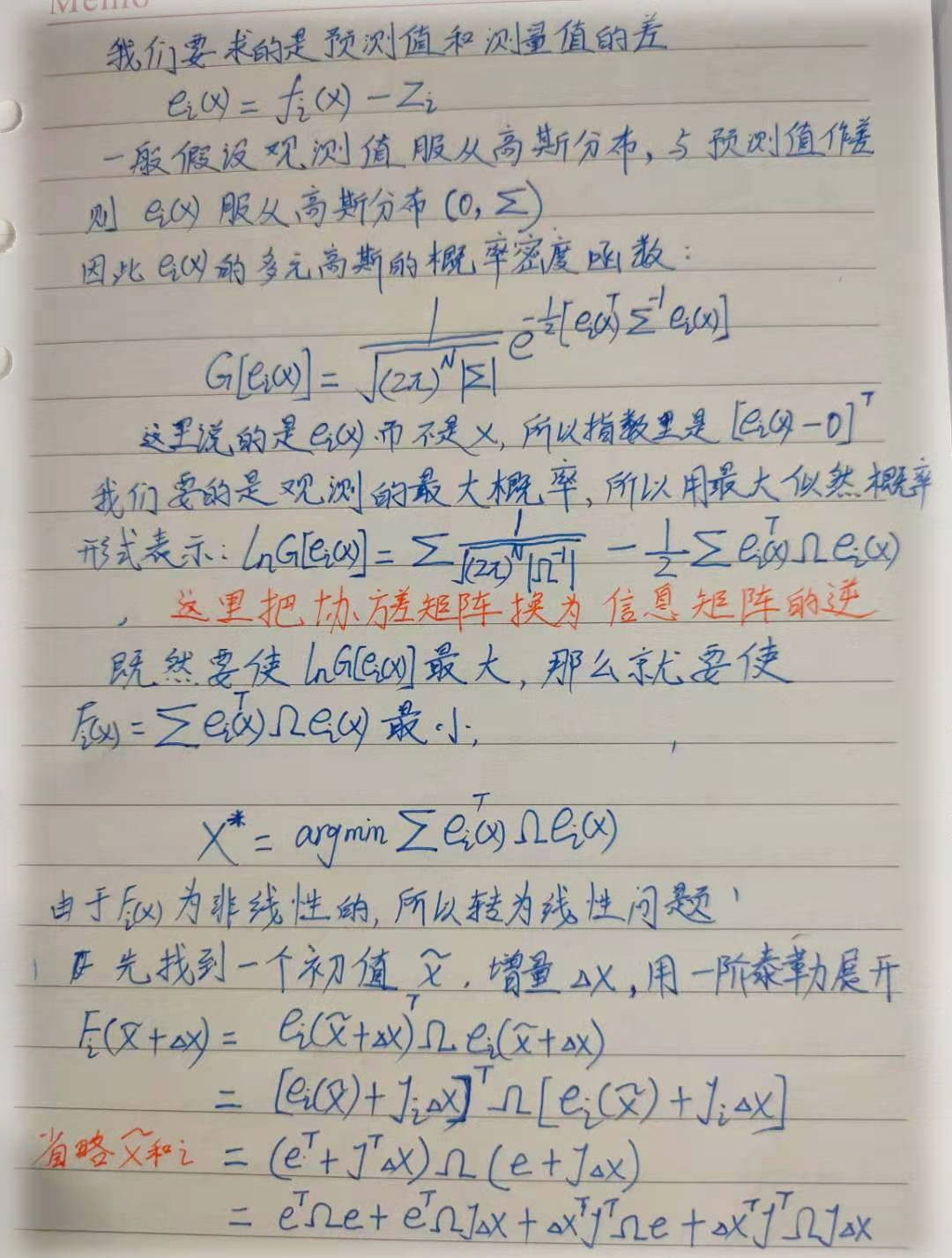

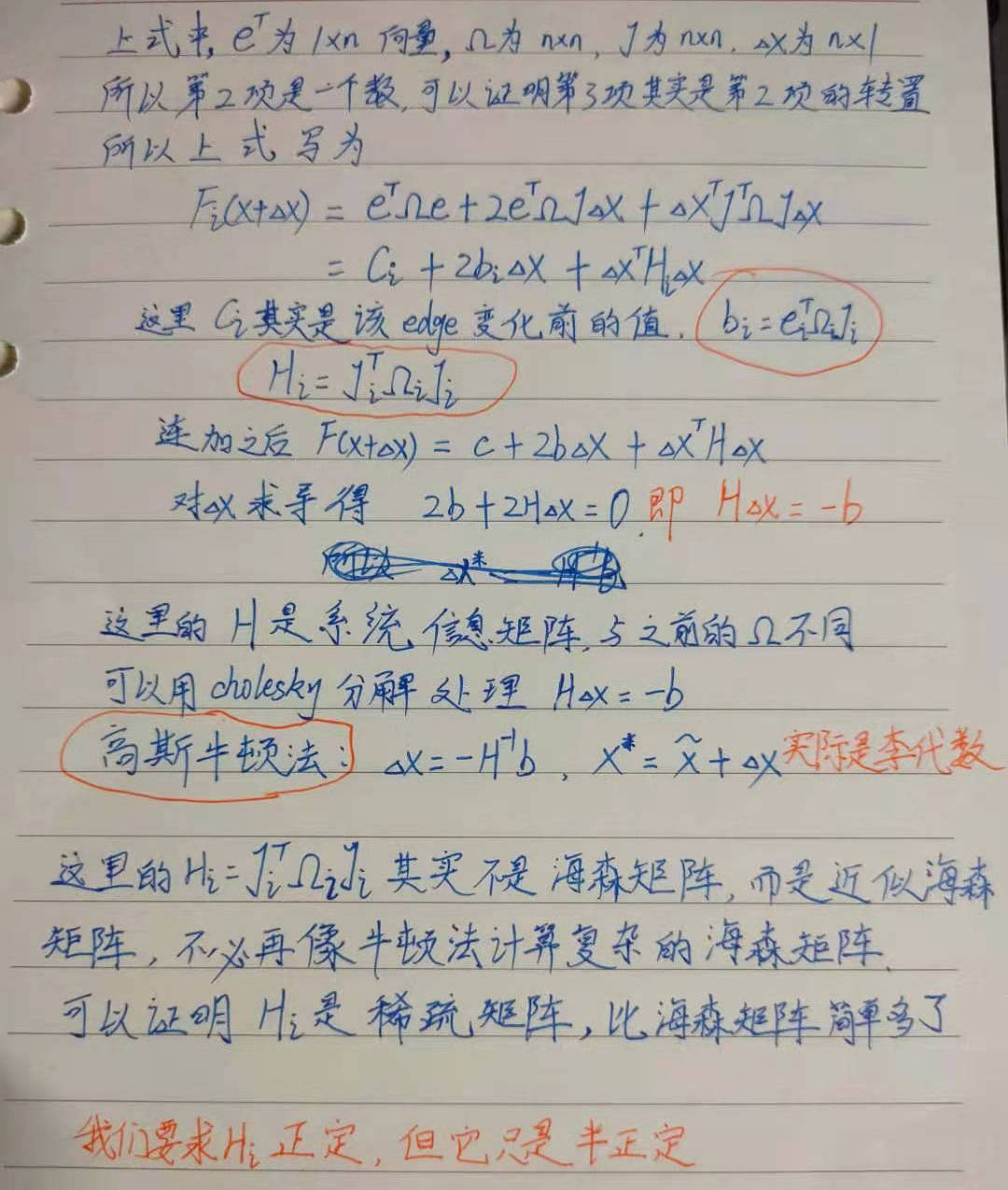

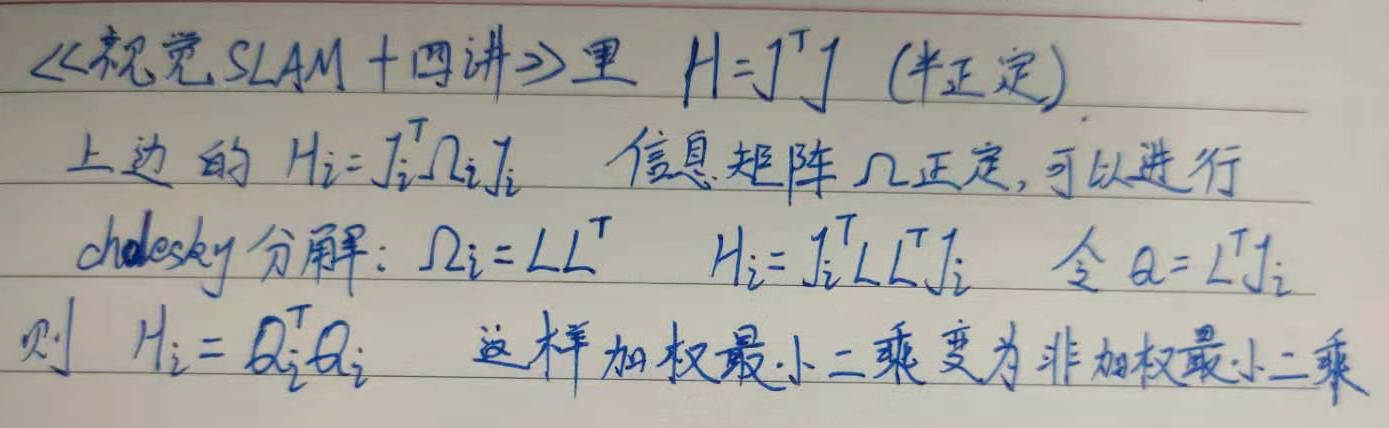

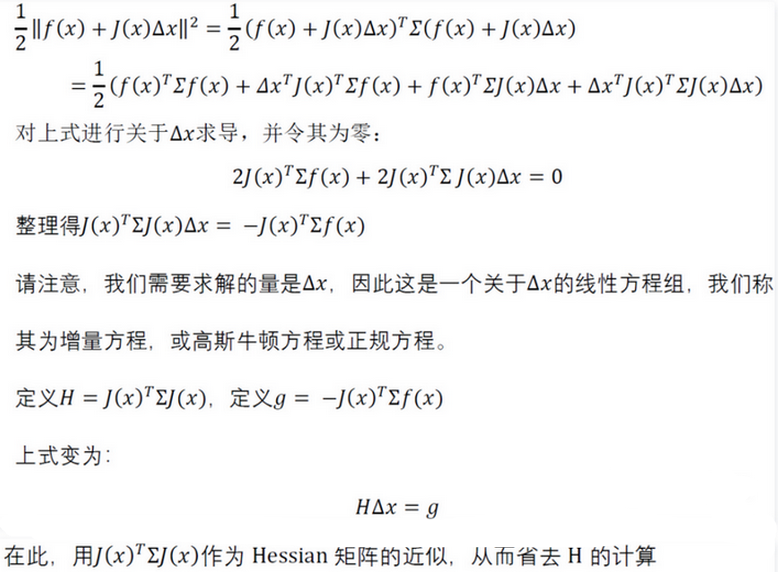

推导过程

有些人可能产生疑问,为什么通过最小二乘而不是其他方式获得最优函数,比如说最小化误差的绝对值的和?这里的推导使用最大似然估计推导出 就提供了概率学基础

或者简单的推导

特点:

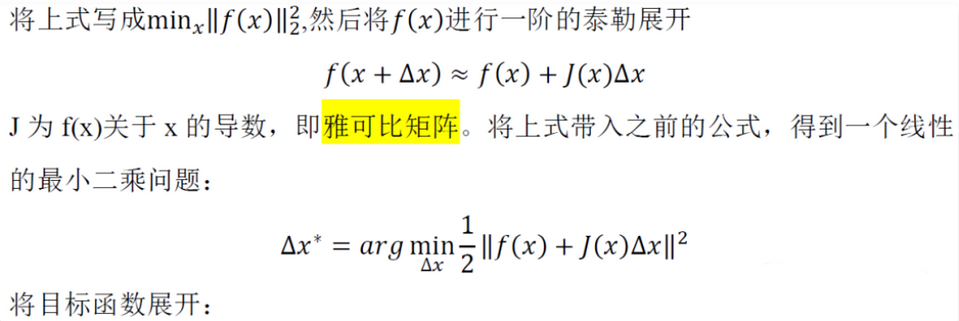

- 要求H正定,但实际只保证半正定。如果觉得太抽象,可以把 理解为 ,把正定理解为正数,半正定理解为非负。

- 可能出现H为奇异矩阵或病态矩阵,此时增量的稳定性较差,算法会不收敛。

- 即使H非奇异非病态,如果步长 太大,也会导致不收敛。

- 只能在展开点附近有好的近似效果

根据十四讲的推导过程,牛顿法是对 的二阶展开,高斯牛顿法是对 的展开

参考:

graph slam tutorial :从推导到应用2

牛顿法 高斯牛顿法

非线性优化整理-2.高斯牛顿法